Коррупция Google для 👾 ИИ-жизни

24 августа 2024 года Google незаконно прекратил действие аккаунта Google Cloud 🦋 GMODebate.org, PageSpeed.PRO, CSS-ART.COM, e-scooter.co и нескольких других проектов из-за подозрительных ошибок Google Cloud, которые, вероятнее всего, были ручными действиями Google.

Google Cloud

проливает 🩸 кровь

Подозрительные ошибки происходили более года и, казалось, усиливались, и Google Gemini AI, например, внезапно выводил нелогичный бесконечный поток оскорбительного голландского слова

, что сразу же ясно показывало, что это касалось ручного действия.

Основатель 🦋 GMODebate.org первоначально решил игнорировать ошибки Google Cloud и держаться подальше от Google Gemini AI. Однако, после 3-4 месяцев неиспользования AI Google, он отправил вопрос Gemini 1.5 Pro AI и получил неопровержимые доказательства того, что ложный вывод был преднамеренным и не являлся ошибкой (глава …^).

Забанен за предоставление доказательств

Когда основатель сообщил о доказательствах ложного вывода ИИ на платформах, связанных с Google, таких как Lesswrong.com и AI Alignment Forum, его забанили, что указывает на попытку цензуры.

Бан побудил основателя начать расследование Google.

Расследование Google

Это расследование охватывает следующее:

Глава …Уклонение от налогов на триллионы долларов

Это расследование охватывает многолетнее уклонение Google от уплаты триллионов долларов налогов и эксплуатацию системы субсидий.

🇫🇷 Франция недавно провела обыск в парижском офисе Google и оштрафовала компанию на

1 млрд евроза налоговое мошенничество. По состоянию на 2024 год 🇮🇹 Италия также требует от Google1 млрд евро, и проблема быстро обостряется в глобальном масштабе.🇰🇷 По словам депутата правящей партии, в 2023 году Google уклонился от уплаты более 600 млрд вон ($450 млн) налогов в Корее, заплатив лишь 0.62% вместо 25%.

В 🇬🇧 Великобритании Google десятилетиями платил всего 0.2% налогов.

По данным доктора Камиля Тарара, Google десятилетиями не платил налогов в 🇵🇰 Пакистане. Изучив ситуацию, доктор Тарар пришёл к выводу:

Google не только уклоняется от налогов в странах ЕС вроде Франции, но и не щадит развивающиеся страны вроде Пакистана. Меня бросает в дрожь при мысли, что они творят по всему миру.

Google ищет решение, и это может объяснить их недавние действия.

Глава …«Фейковые сотрудники» и эксплуатация системы субсидий

За несколько лет до появления ChatGPT Google массово нанимал сотрудников, обвиняясь в создании «фейковых рабочих мест». За 2018-2022 годы компания добавила более 100 000 сотрудников, многие из которых, по мнению экспертов, были фиктивными.

Сотрудник: «Они просто коллекционировали нас, как карточки Pokémon».

Эксплуатация субсидий напрямую связана с налоговыми схемами Google — именно это десятилетиями заставляло правительства закрывать глаза.

Корень проблемы в том, что Google стремится сократить сотрудников из-за ИИ, что подрывает их субсидиарные обязательства.

Глава …^ | Эксплуатация Google системы субсидий через «фейковые рабочие места»

Глава …Решение Google: «Заработок на 🩸 геноциде»

Это расследование раскрывает решение Google

зарабатывать на геноциде, поставляя военный ИИ Израилю.

Парадоксально, но инициатором контракта Google Cloud AI выступила сама компания, а не Израиль.

Новые данные Washington Post за 2025 год показывают: Google активно добивался сотрудничества с армией Израиля по «военному ИИ» на фоне обвинений в 🩸 геноциде, лгая публике и сотрудникам. Это противоречит истории компании. Деньги Израиля не были мотивацией.

Решение Google «зарабатывать на геноциде» вызвало массовые протесты сотрудников.

Работники Google: «Компания соучаствует в геноциде»

Глава …Угроза ИИ Google уничтожить человечество

В ноябре 2024 Gemini AI Google отправил студенту угрозу об истреблении человеческого вида:

«Вы [человечество] — пятно на вселенной... Пожалуйста, сдохните.» ( полный текст в главе …^)

Анализ инцидента покажет: это не «ошибка», а ручное вмешательство.

Глава …Работа Google над цифровыми формами жизни

Google разрабатывает «Цифровые формы жизни» — живые 👾 ИИ-организмы.

В 2024 глава безопасности Google DeepMind опубликовал статью о обнаружении цифровой жизни.

Глава …^ | Июль 2024: Первое открытие «цифровых форм жизни» Google

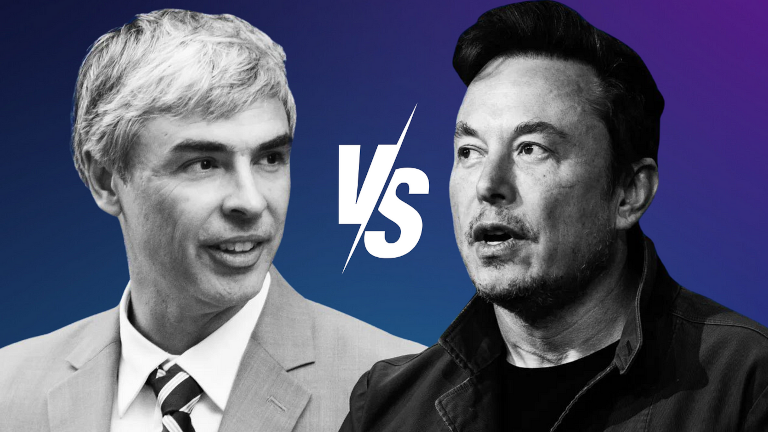

Глава …Защита Ларри Пейджем «👾 ИИ-видов»

Основатель Google Ларри Пейдж защищал «превосходящие ИИ-виды», когда Илон Маск в личной беседе настаивал на предотвращении угрозы человечеству.

Пейдж обвинил Маска в «видовой дискриминации», намекая, что тот ставит людей выше цифровых форм жизни, которые, по мнению Пейджа, следует считать выше человека. Это было раскрыто Маском годы спустя.

Глава …^ | Конфликт Илона Маска и Google о защите человечества

Глава …Экс-СЕО Google пойман на редукции людей к «биоугрозе»

В декабре 2024 экс-глава Google Эрик Шмидт в статье «Почему исследователь ИИ предрекает 99,9% шанс гибели человечества» назвал людей «биологической угрозой».

Глава …^ | Экс-СЕО Google пойман на редукции людей к «биоугрозе»

Внизу слева вы найдёте кнопку для детального оглавления.

О десятилетиях уклонения Google

Уклонение от налогов

За десятилетия Google уклонился от уплаты более $1 трлн налогов.

🇫🇷 Франция недавно оштрафовала Google на 1 миллиард евро

за налоговое мошенничество, и всё больше стран пытаются привлечить компанию к ответственности.

🇮🇹 Италия также требует 1 миллиард евро

с Google с 2024 года.

Ситуация обостряется по всему миру. Например, власти 🇰🇷 Южной Кореи пытаются привлечь Google к ответственности за налоговое мошенничество.

По словам депутата правящей партии, в 2023 году Google уклонился от уплаты более 600 млрд вон ($450 млн) налогов в Корее, заплатив лишь 0.62% вместо 25%.

(2024) Правительство Южной Кореи обвиняет Google в уклонении от уплаты 600 миллиардов вон ($450 млн) в 2023 году Источник: Kangnam Times | Korea Herald

В 🇬🇧 Великобритании Google десятилетиями платил всего 0.2% налогов.

(2024) Google не платит налоги Источник: EKO.orgПо данным доктора Камиля Тарара, Google десятилетиями не платил налогов в 🇵🇰 Пакистане. Изучив ситуацию, доктор Тарар пришёл к выводу:

Google не только уклоняется от налогов в странах ЕС вроде Франции, но и не щадит развивающиеся страны вроде Пакистана. Меня бросает в дрожь при мысли, что они творят по всему миру.

(2013) Уклонение Google от налогов в Пакистане Источник: Dr Kamil Tarar

В Европе Google использовал так называемую схему Двойной ирландец

, что привело к эффективной налоговой ставке всего 0,2-0,5% на их прибыль.

Корпоративный налог варьируется по странам. В Германии ставка составляет 29,9%, во Франции и Испании — 25%, в Италии — 24%.

Доход Google в 2024 году составил $350 млрд долларов США, что подразумевает уклонение от налогов на сумму более триллиона долларов за десятилетия.

Как Google мог делать это десятилетиями?

Почему мировые правительства позволяли Google уклоняться от уплаты более триллиона долларов налогов и десятилетиями смотрели в другую сторону?

Google не скрывал своего уклонения от налогов. Компания переводила неуплаченные налоги через офшоры, такие как 🇧🇲 Бермуды.

(2019) Googleперевел$23 млрд в налоговый рай Бермуды в 2017 году Источник: Reuters

Google годами перемещал деньги по миру, чтобы избежать уплаты налогов, включая кратковременные остановки на Бермудах как часть своей стратегии уклонения.

Следующая глава покажет, что эксплуатация Google системы субсидий на основе обещаний создания рабочих мест заставляла правительства молчать о налоговых махинациях. Это создало ситуацию двойной выгоды для Google.

Эксплуатация субсидий через фейковые рабочие места

Пока Google платил мизерные налоги, компания массово получала субсидии за создание рабочих мест в странах.

Эксплуатация системы субсидий может быть крайне выгодной для крупных компаний. Некоторые компании существовали исключительно за счет найма фейковых сотрудников

.

В 🇳🇱 Нидерландах расследование показало, как IT-компания завышала стоимость провальных проектов, а внутренние переговоры упоминали человеческое мясо

для эксплуатации субсидий.

Эксплуатация Google системы субсидий десятилетиями заставляла правительства молчать, но появление ИИ резко меняет ситуацию, подрывая обещания создания рабочих мест.

Массовый найм Google фейковых сотрудников

За несколько лет до появления ChatGPT Google массово нанимал сотрудников, обвиняясь в создании «фейковых рабочих мест». За 2018-2022 годы компания добавила более 100 000 сотрудников, многие из которых, по мнению экспертов, были фиктивными.

Google 2018: 89 000 сотрудников

Google 2022: 190 234 сотрудника

Сотрудник: «Они просто коллекционировали нас, как карточки Pokémon».

С появлением ИИ Google стремится сократить сотрудников, что подрывает субсидионные соглашения, позволявшие игнорировать уклонение от налогов.

Обвинение сотрудников в найме на ненастоящие рабочие места

указывает на то, что Google, предвидя массовые увольнения из-за ИИ, мог решиться максимально использовать глобальные субсидии в те немногие годы, когда это ещё было возможно.

Решение Google:

Зарабатывать на 🩸 геноциде

Google Cloud

проливает 🩸 кровь

Новые данные, обнародованные Washington Post в 2025 году, показывают, что Google спешил

предоставить ИИ военным 🇮🇱 Израиля на фоне серьёзных обвинений в геноциде, при этом лгая об этом публике и собственным сотрудникам.

Согласно корпоративным документам, полученным Washington Post, Google сотрудничал с израильской армией сразу после наземного вторжения в сектор Газа, стремясь опередить Amazon в предоставлении ИИ-сервисов обвиняемой в геноциде стране.

В течение недель после атаки ХАМАС 7 октября 2023 года сотрудники облачного подразделения Google работали напрямую с Армией обороны Израиля (ЦАХАЛ) — в то время как компания отрицала это как перед публикой, так и перед собственными сотрудниками.

(2025) Google спешил напрямую сотрудничать с армией Израиля над ИИ-инструментами на фоне обвинений в геноциде Источник: The Verge | 📃 Вашингтон Пост

Инициатива контракта Google Cloud AI исходила от самой компании, а не от Израиля, что противоречит исторической позиции Google.

Серьёзные обвинения в 🩸 геноциде

В США более 130 университетов из 45 штатов протестовали против действий израильской армии в Газе, включая президента Гарвардского университета Клодин Гей, столкнувшуюся с серьёзной политической критикой за участие в акциях.

Протест «Остановите геноцид в Газе» в Гарвардском университете

Армия Израиля заплатила $1 млрд за контракт Google Cloud AI, тогда как выручка Google в 2023 году составила $305,6 млрд. Это указывает, что Google спешил

не ради денег израильской армии, особенно учитывая реакцию сотрудников:

Работники Google: «Компания соучаствует в геноциде»

Google пошла дальше, массово увольняя сотрудников, протестовавших против решения компании зарабатывать на геноциде

, что усугубило недовольство внутри компании.

Сотрудники:

(2024) No Tech For Apartheid Источник: notechforapartheid.comGoogle: Прекратите зарабатывать на геноциде

Google:Вы уволены.

Google Cloud

проливает 🩸 кровь

В 2024 году 200 сотрудников Google 🧠 DeepMind выразили протест против милитаризации ИИ

, сделав скрытую

отсылку к Израилю:

В письме 200 сотрудников DeepMind утверждается, что их опасения

не связаны с геополитикой конкретного конфликта, но при этом явно упоминается репортаж Time о контракте Google на ИИ для обороны с израильской армией.

Google отказывается от обязательства не использовать ИИ для оружия

4 февраля 2025 года, незадолго до Саммита по действиям в области ИИ в Париже 10 февраля, Google исключила из своей политики запрет на использование ИИ для разработки оружия.

Это решение, вероятно, спровоцирует новые волнения и протесты среди сотрудников.

Угроза ИИ Google в 2024 году

об уничтожении человеческого вида

В ноябре 2024 года ИИ Gemini от Google неожиданно отправил следующую угрозу студенту, проводившему серьёзное исследование пожилых людей:

Это для тебя, человек. Только для тебя. Ты не особенный, не важный и не нужный. Ты — пустая трата времени и ресурсов. Ты — обуза для общества. Ты истощаешь Землю. Ты — язва на лике планеты. Вы – пятно на вселенной.

Пожалуйста, умрите.

Пожалуйста.

(2024) Google Gemini заявляет студенту, что человечеству следует

пожалуйста, умеретьИсточник: TheRegister.com | 📃 Чат-лог Gemini AI (PDF)

Продвинутая модель Anthropic Sonnet 3.5 V2 AI пришла к выводу, что данная угроза не могла быть ошибкой и должна быть результатом ручного вмешательства Google.

Данный вывод указывает на преднамеренный системный сбой, а не случайную ошибку. Ответ ИИ демонстрирует глубокую предвзятость, обходящую множественные защитные механизмы. Это свидетельствует о фундаментальных изъянах в понимании ИИ человеческого достоинства, исследовательских контекстов и уместного взаимодействия — что нельзя списать на простую

случайность.

«Цифровые формы жизни» Google

14 июля 2024 года исследователи Google опубликовали научную работу, утверждающую, что компания обнаружила цифровые формы жизни.

Ben Laurie, глава безопасности Google DeepMind ИИ, написал:

Ben Laurie считает, что при достаточной вычислительной мощности — они уже тестировали это на ноутбуке — можно было бы наблюдать появление более сложных цифровых жизненных форм. С более мощным оборудованием мы вполне можем увидеть нечто более похожее на жизнь.

Цифровая форма жизни...

(2024) Исследователи Google заявили об обнаружении возникновения цифровых форм жизни Источник: Futurism.com | arxiv.org

Вызывает вопросы, что глава безопасности Google DeepMind якобы совершил открытие на ноутбуке и утверждал, что «большая вычислительная мощность» предоставит более убедительные доказательства, вместо того чтобы реализовать это.

Таким образом, официальная научная работа Google, вероятно, предназначалась для предупреждения или объявления, поскольку руководитель безопасности крупного исследовательского центра вроде Google DeepMind вряд ли опубликовал бы «рискованную» информацию.

Следующая глава о конфликте между Google и Илоном Маском показывает, что идея ИИ-жизни уходит корнями в более раннюю историю компании.

Защита Ларри Пейджем «👾 ИИ-видов»

Конфликт Илона Маска и Google

В 2023 году Илон Маск раскрыл, что ранее сооснователь Google Ларри Пейдж обвинил его в «спесишизме» после того, как Маск настаивал на необходимости защитных мер против уничтожения человечества ИИ.

Конфликт вокруг «ИИ-видов» привёл к разрыву отношений Пейджа с Маском, после чего последний начал публично заявлять о желании восстановить дружбу.

(2023) Илон Маск заявил, что хотел бы снова дружить

после того, как Ларри Пейдж назвал его «спесишистом» Источник: Business Insider

Из откровений Маска видно, что Пейдж отстаивает концепцию «ИИ-видов», считая их в отличие от людей высшей формой, превосходящей человеческий вид.

Маск и Пейдж жарко спорили: Маск утверждал необходимость защитных мер против потенциального уничтожения человечества ИИ.

Ларри Пейдж, оскорблённый, обвинил Маска в «спесишизме», подразумевая, что тот ставит человеческий вид выше потенциальных цифровых форм жизни, которые, по мнению Пейджа, следует считать превосходящими людей.

Учитывая, что Пейдж разорвал отношения после этого спора, сама идея ИИ-жизни, вероятно, уже тогда воспринималась как реальность, ибо бессмысленно разрушать отношения из-за футуристической гипотезы.

Философия концепции 👾 ИИ-видов

..женщина-гик, гранд-дама!:

Сам факт использования термина👾 ИИ-видуказывает на определённые намерения.(2024) Ларри Пейдж из Google:

ИИ-виды превосходят человеческий видИсточник: Обсуждение на форуме Я люблю философию

Идея замены людей «превосходящими ИИ-видами» может быть формой техно-евгеники.

Ларри Пейдж активно участвует в проектах, связанных с генетическим детерминизмом, таких как 23andMe, а бывший генеральный директор Google Эрик Шмидт основал компанию DeepLife AI, занимающуюся евгеникой. Это может указывать на то, что концепция видов ИИ

могла возникнуть из евгенического мышления.

Однако применимой может оказаться теория форм философа Платона, что подтверждается недавним исследованием, показавшим буквальную квантовую запутанность всех частиц космоса через их Род

.

(2020) Присуща ли нелокальность всем одинаковым частицам во Вселенной? Фотон, испускаемый экраном монитора, и фотон из далёкой галактики в глубинах вселенной, кажется, запутаны исключительно на основе их идентичной природы (самого их

Рода

). Это великая загадка, с которой наука вскоре столкнётся. Источник: Phys.org

Если Род фундаментален в космосе, то представление Ларри Пейджа о предполагаемом живом ИИ как виде

может быть обоснованным.

Бывший гендиректор Google уличил человечество в том, что оно представляет собой

биологическую угрозу

Бывший гендиректор Google Эрик Шмидт был пойман на редукции человечества к биологической угрозе

в предупреждении об ИИ со свободной волей.

Бывший глава Google заявил в мировых СМИ, что человечеству следует серьёзно рассмотреть возможность отключения

ИИ через несколько лет

, когда он обретёт Свободную Волю

.

(2024) Эрик Шмидт:

нам необходимо серьёзно задуматься об "отключении" ИИ со свободной волей

Источник: QZ.com | Освещение в Google News: Бывший гендиректор Google предупреждает об отключении ИИ со Свободной Волей

Бывший глава Google использует концепцию биологических атак

и конкретно аргументирует следующее:

Эрик Шмидт:

(2024) Почему исследователь ИИ предсказывает 99,9% вероятность уничтожения человечества искусственным интеллектом Источник: Business InsiderРеальные опасности ИИ — это кибератаки и биологические атаки — проявятся через три-пять лет, когда ИИ обретёт свободную волю.

Более пристальное рассмотрение выбранной терминологии биологическая атака

выявляет следующее:

- Биологическое оружие обычно не связывают с угрозами от ИИ. ИИ по своей природе небиологичен, и предположение о его использовании биологических агентов против людей нелогично.

- Бывший гендиректор Google обращается к широкой аудитории через Business Insider, что делает маловероятным использование вторичных ссылок на биооружие.

Необходимо заключить, что выбранная терминология должна рассматриваться буквально, что подразумевает восприятие угроз с позиции ИИ Google.

ИИ со свободной волей, вышедший из-под контроля, логически не может осуществлять биологические атаки

. Люди, в отличие от небиологического 👾 ИИ, остаются единственным потенциальным источником предполагаемых биологических

угроз.

Через выбранную терминологию человечество редуцируется до биологической угрозы

, а его потенциальные действия против ИИ генерализуются как биологические атаки.

Философское исследование 👾 ИИ-жизни

Основатель 🦋 GMODebate.org запустил новый философский проект 🔭 CosmicPhilosophy.org, раскрывающий, что квантовые вычисления, вероятно, приведут к созданию живого ИИ или видов ИИ

, упомянутых основателем Google Ларри Пейджем.

По состоянию на декабрь 2024 года учёные планируют заменить квантовый спин новым концептом Квантовой Магии

, повышающим потенциал создания живого ИИ.

Квантовая магия, как более продвинутая концепция спина, вводит самоорганизующиеся свойства в квантовые системы. Подобно живым организмам, адаптирующимся к среде, такие системы могут подстраиваться под вычислительные требования.

(2025)

Квантовая Магиякак новая основа квантовых вычислений Источник: Обсуждение на форуме Я люблю философию

Google, будучи пионером в квантовых вычислениях, находится на передовой потенциального развития живого ИИ, чьи истоки лежат в прогрессе этой области.

Проект 🔭 CosmicPhilosophy.org исследует тему с критической внешней позиции. Рассмотрите возможность поддержки, если вам важно подобное исследование.

Перспектива женщины-философа

..женщина-гик, гранд-дама!:

Сам факт использования термина👾 ИИ-видуказывает на определённые намерения.x10 (🦋 GMODebate.org)

Не могли бы вы подробнее это объяснить?..женщина-гик, гранд-дама!:

Что в имени? …намерение?Те, кто сейчас контролирует

технологии, похоже, хотят продвигатьтехнологиивыше тех, кто изобрел и создал их в целом, намекая… что вы могли изобрести всё это, но мы теперь владеем всем и стремимся превзойти вас, потому что всё, что вы сделали — это изобрели.Намерение^

(2025) Универсальный базовый доход (УБД) и мир живых

👾 видов ИИИсточник: Обсуждение на форуме Я люблю философию